Zaawansowane aplikacje generatywnej AI pomogą nam szybciej wykonywać pracę. Zdejmą z nas monotonne zadania i pozwolą skupić się na tych bardziej kreatywnych. Sztuczna inteligencja wesprze nas w tworzeniu aplikacji, które oferują jeszcze bardziej użyteczne, osobiste i angażujące doświadczenia.

To właśnie było głównym wątkiem szczytu Amazon Web Services Summit w Nowym Jorku. AWS ogłosił szereg nowych rozwiązań, które mają pomóc klientom – niezależnie od ich wiedzy specjalistycznej w zakresie AI – szybciej i łatwiej budować aplikacje bazujące na AI.

Podczas wydarzenia Matt Wood, wiceprezes AWS ds. produktów AI, wyjaśnił, jak firmy chcące zintegrować najważniejszy przełom technologiczny ostatniej dekady, mogą to zrobić dzięki Amazon Web Services – wydajnie, na dużą skalę i z odpowiednimi zabezpieczeniami. Matt Wood w swoim przemówieniu inauguracyjnym, wygłoszonym podczas Amazon Web Services Summit, zwrócił uwagę, że AWS oferuje ponad dwukrotnie więcej ogólnodostępnych funkcji uczenia maszynowego i generatywnej sztucznej inteligencji niż łącznie wszyscy pozostali główni dostawcy usług w chmurze.

Poznaj rozwiązania zaprezentowane podczas Amazon Web Services Summit w Nowym Jorku:

1. AWS App Studio – możliwość tworzenia aplikacji z użyciem AI w ciągu kilku minut

To wiadomość szczególnie dobra dla osób pracujących w branży technologicznej, których codzienna praca niekoniecznie polega na pisaniu kodu (np. kierowników projektów IT lub inżynierów danych). AWS przychodzi z najłatwiejszym sposobem na tworzenie bezpiecznych aplikacji, które mogą rozwiązywać problemy biznesowe w ciągu kilku minut, a nie dni czy tygodni.

To nowa odsłona AWS App Studio – platformy niskokodowej zasilanej przez generatywną AI (co oznacza, że pisanie kodu jest w większości wykonywane za użytkownika). Przykład? Jeśli potrzebujesz śledzić zasoby swoich towarów, możesz wykorzystać do tego aplikację stworzoną samodzielnie w AWS App Studio, zamiast zlecać to drogiemu zespołowi programistów. Wystarczy, że odpowiednią komendą (tzw. promptem) opiszesz aplikację, której potrzebujesz – np. „Zbuduj aplikację do przeglądania i zatwierdzania faktur”. App Studio wygeneruje taki program, uwzględniając interfejs użytkownika do wyświetlania faktur, model danych dla rekordów zatwierdzania, a nawet system kierowania tymi rekordami. Ponadto, oprogramowanie od AWS automatycznie tworzy makiety danych, co sprawia, że twórcy mogą od razu zobaczyć, jak działa ich aplikacja, nie zaprzątając sobie głowy kodem bazowym. Wdrażanie, operacje i konserwacja są w pełni obsługiwane przez App Studio, czego efektem końcowym jest bezpieczna i skalowalna aplikacja ułatwiająca pracę. Tutaj dowiesz się więcej o AWS App Studio.

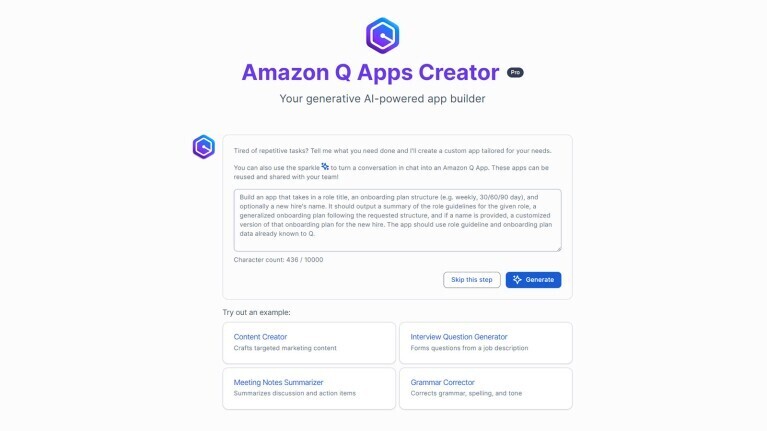

2. Amazon Q Apps – AWS upowszechnia dostęp do generatywnej sztucznej inteligencji

Nie pracujesz na stanowisku technicznym? Bez obaw. Amazon Q Business od AWS przychodzi z usługą Amazon Q Apps, która zapewnia pomoc generatywnej AI w takich zadaniach jak: tworzenie oprogramowania, podsumowywanie danych i tworzenie treści. Teraz dzięki Amazon Q Apps z łatwością przejdziesz od idei do konkretnego projektu aplikacji opartej na generatywnej AI. Wystarczy opisać, czego potrzebujemy, a Q natychmiast to urzeczywistnia. „Czy możesz podsumować najważniejsze wnioski ze spotkania” lub „Potrzebuję pomocy w pisaniu dokumentacji korporacyjnej” – Q utworzy aplikację, która zautomatyzuje te zadania zarówno teraz, jak i na przyszłość.

3. Amazon Q Developer w Amazon SageMaker – oszczędność miesięcy pracy analityków danych

Amazon Q Developer jest zawsze tam, gdzie go potrzebujesz, a żeby sprostać kolejnym wyzwaniom, teraz dostępny jest również w SageMaker Studio.

Proces opracowywania modelu uczenia maszynowego jest złożony, a naukowcy zajmujący się danymi spędzają zbyt wiele czasu na szukaniu odpowiednich narzędzi, dokumentacji czy samego podejścia do badań. Aby sprostać tym wyzwaniom i oszczędzić czas analityków danych, Amazon Q Developer jest teraz dostępny w SageMaker Studio. Za pomocą prostego czatu użytkownicy mogą poprosić Amazon Q Developer o np. rekomendację narzędzi czy też zasugerowanie kodu do tworzenia modeli uczenia maszynowego.

4. Amazon Bedrock dodaje nowe funkcje, by przyspieszyć i ułatwić tworzenie i wdrażanie aplikacji generatywnego AI

Amazon Bedrock to w pełni zarządzana usługa, która ułatwia dostęp do wysokowydajnych dużych modeli językowych (ang. large language models, LLM) i innych modeli fundamentalnych (foundation model, FM) – stanowiących elementy składowe aplikacji bazujących na generatywnej AI – od wiodących firm z branży AI. Jednak tworzenie takiej aplikacji wymaga czegoś więcej niż dostępu do modeli fundamentalnych. Bedrock oferuje szeroki zestaw możliwości niezbędnych do tworzenia aplikacji bazujących na generatywnej AI z zachowaniem bezpieczeństwa i prywatności.

Ta zawartość jest udostępniana przez serwis zewnętrzny (www.youtube.com).

Aby wyświetlić zawartość, należy wyrazić zgodę na pliki cookie, wybierając opcję Zaakceptuj wszystkie w pojawiającym się banerze. Można też przejść do stopki strony, wybrać opcję Preferencje plików cookie, a następnie wybrać Wł. w sekcji Funkcjonalne pliki cookie, Pliki cookie wydajności i Reklamowe pliki cookie.

Podczas Amazon Web Services Summit w Nowym Jorku AWS ogłosił szereg nowych możliwości dla Amazon Bedrock – udostępniając klientom możliwość dostosowywania modeli za pomocą własnych danych i oferując więcej zabezpieczeń dla aplikacji wykorzystujących generatywną AI.

Oto najważniejsze z nowości:

Funkcja precyzyjnego dostrajania Anthropic Claude 3 Haiku już w wersji testowej

Claude 3 Haiku to najbardziej kompaktowy model od Anthropic i jedna z najprzystępniejszych oraz najszybszych opcji na rynku w swojej kategorii. Amazon Bedrock jest jedyną w pełni zarządzaną usługą, która zapewnia możliwość dostrajania modeli Claude’a.

Nierzadko programiści chcą dostosowywać ogromne możliwości Claude'a do konkretnych aplikacji. Narzędzia do dostrajania dostępne w Amazon Bedrock umożliwiają im wykorzystywanie własnych danych do tworzenia aplikacji, które są w pełni sprofilowane pod ich domeny, organizacje czy sposoby używania, a jednocześnie odzwierciedlają zastrzeżone informacje: markę, głos i produkty danej firmy. Mogą również stworzyć i trenować prywatną kopię swojego modelu, zachowując przy tym bezpieczeństwo danych używanych do trenowania.

Aktualizacje do Guardrails

Niezależnie od tego, jak szybko powstają aplikacje AI, muszą działać w sposób bezpieczny i odpowiedzialny. Rozwiązanie Guardrails dla Amazon Bedrock pozwala klientom tworzyć ochronę prywatności i bezpieczeństwa dla swoich aplikacji. Najnowsze narzędzie łączy wyniki otrzymywane od modelu z weryfikowalnymi źródłami informacji (ang. contextual grounding checks). Umożliwia to klientom korzystającym z technik Retrieval Augmented Generation (RAG) wykrywanie sytuacji, w których sztuczna inteligencja tworzy niedokładne lub niepoprawne odpowiedzi i idee, znane jako tzw. halucynacje.

AWS przedstawił również interfejs programowania aplikacji (ang. application programming interface, API), który pozwala klientom korzystać z Guardrails w dowolnym modelu – nawet w tych nieobsługiwanych przez Amazon Bedrock.

Tworzenie bardziej zaawansowanych i spersonalizowanych funkcji Agent

Dzięki funkcji Agent dostępnej w Amazon Bedrock, aplikacje mogą wykonywać wieloetapowe zadania przy użyciu systemów firmowych i źródeł danych. Podczas Amazon Web Services Summit w Nowym Jorku ogłoszono kolejne, nowe możliwości funkcji Agent. Jak dotąd funkcjonowanie narzędzia ograniczało się do podejmowania działań w oparciu o informacje z pojedynczej sesji. Natomiast od teraz technologia zapamiętuje, gdzie użytkownik ostatnio przerwał sesję i w oparciu o wcześniejsze interakcje dostarcza lepszych rekomendacji. Weźmy za przykład aplikację do rezerwacji lotów – deweloper może ustawić funkcję Agent w taki sposób, że zapamięta ona kiedy odbyła się ostatnia podróż albo że poprzednim razem wybrano posiłek wegetariański.

5. Przeszkoliliśmy 31 mln osób w zakresie chmury obliczeniowej – i nie powiedzieliśmy jeszcze ostatniego słowa

AWS postawił sobie za cel, aby do 2025 r. zapewnić bezpłatne szkolenia z przetwarzania w chmurze dla 29 mln osób na całym świecie. Podczas AWS Summit w Nowym Jorku ogłoszono, że udało się ten cel zrealizować o ponad rok wcześniej niż zakładano. Firma podała, że przeszkoliła już ponad 31 mln kursantów w 200 krajach i terytoriach, budując ich umiejętności w zakresie chmury poprzez bezpłatne inicjatywy szkoleniowe.